Nếu bạn đang xây dựng AI Agent, cần biết rõ một điều: chi phí API có thể “ăn” hết ngân sách trước khi sản phẩm kịp ra mắt. Do đó, để tối ưu ngân sách trong quá trình thử nghiệm và triển khai, việc tận dụng những nguồn cung cấp API Key miễn phí là giải pháp cực kỳ hiệu quả. Bài viết dưới đây sẽ tổng hợp danh sách top 10+ nền tảng LLM lấy API Key miễn phí cho AI Agent của bạn.

Tại sao việc chọn đúng LLM miễn phí quan trọng với AI Agent?

AI Agent khác chatbot thông thường ở chỗ: mỗi vòng lặp suy nghĩ – hành động (think–act loop) của agent đều tốn ít nhất một lần gọi API. Một agent phức tạp có thể tạo ra hàng chục, thậm chí hàng trăm request mỗi phiên làm việc. Với mô hình tính phí theo token, chi phí tích lũy rất nhanh.

Chọn đúng provider miễn phí sẽ giúp bạn:

- Phát triển và thử nghiệm không tốn kém

- Kết hợp nhiều provider theo từng loại tác vụ (routing)

- Trì hoãn thời điểm phải nâng cấp lên gói trả phí

Tiêu chí lựa chọn trong bài này:

- Free tier vĩnh viễn (không phải trial)

- Không yêu cầu thẻ tín dụng khi đăng ký

- API tương thích OpenAI-format (dễ tích hợp vào agent framework như LangChain, CrewAI, AutoGen…)

Top 10+ LLM lấy API Key miễn phí cho AI Agent

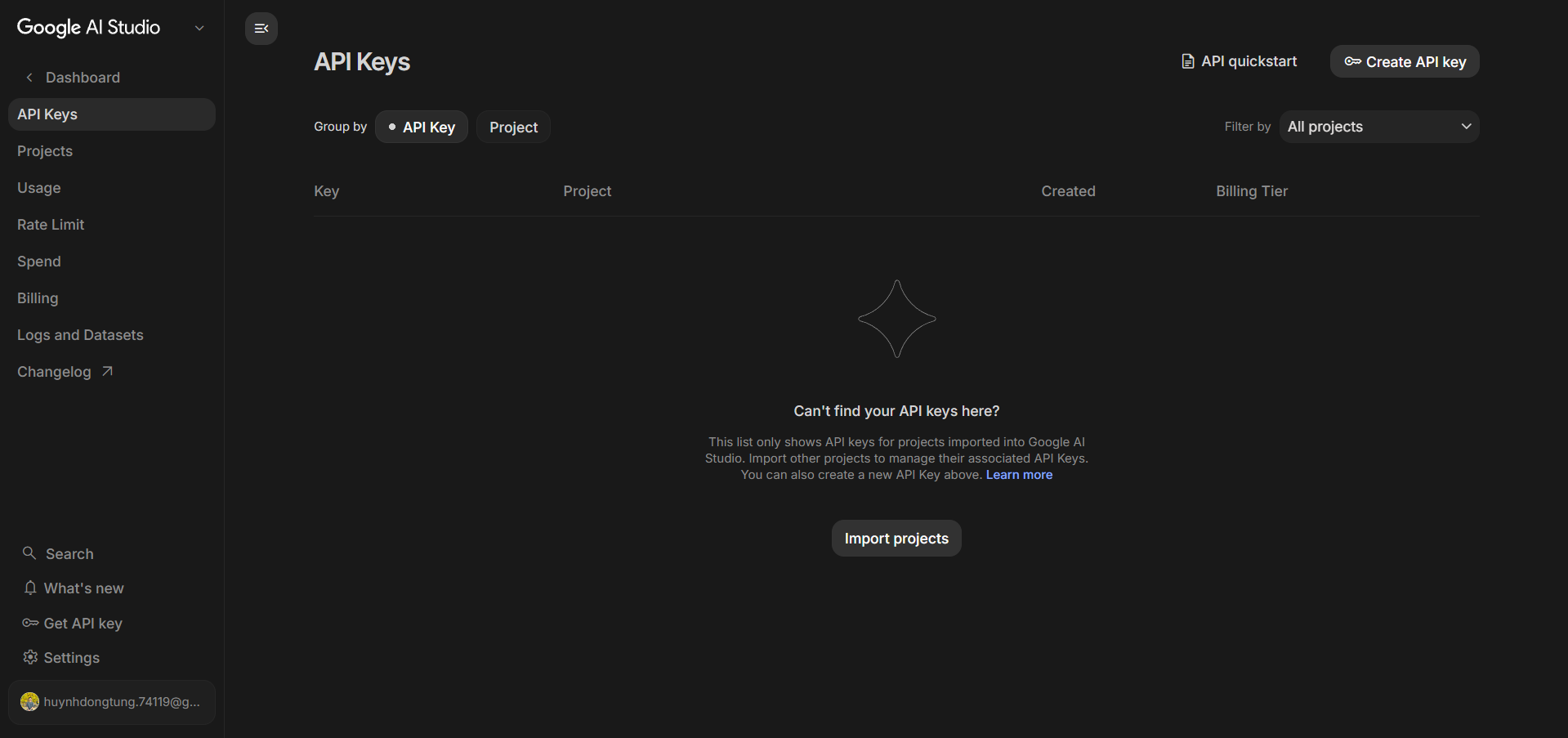

1. Google AI Studio

Link: aistudio.google.com

Đây là nền tảng hào phóng nhất hiện nay dành cho các mô hình ngôn ngữ lớn (Frontier Models). Dòng Gemini 2.5 Flash cung cấp tới 1.500 yêu cầu mỗi ngày cùng cửa sổ ngữ cảnh (context window) lên đến 1 triệu token. Khả năng đa phương thức (multimodal) cho phép gửi kèm hình ảnh, âm thanh và PDF mà không mất phí.

Xem thêm: Hướng dẫn cách lấy API Key của Gemini AI

Giới hạn thực tế (tháng 5/2026):

- Gemini 2.5 Flash: 500 RPD (requests/day), 10 RPM

- Gemini 2.5 Flash-Lite: 1.000 RPD, 15 RPM

- Tất cả model chia sẻ cap 250K token/phút

Phù hợp nhất cho: Phân tích tài liệu dài, kiểm tra mã nguồn hoặc xây dựng Agent xử lý dữ liệu đa phương tiện.

Lưu ý: Google có thể sử dụng dữ liệu từ free tier để cải thiện mô hình trừ khi bạn tắt tùy chọn này trong phần cài đặt tài khoản. Free tier không có SLA và không dành cho production quy mô lớn.

2. Groq

Link: console.groq.com

Groq sử dụng chip LPU (Language Processing Unit) độc quyền thay vì GPU thông thường, cho phép inference với tốc độ hơn 300 token/giây trên Llama 3.3 70B — nhanh gấp nhiều lần so với các provider GPU thông thường. Đây là yếu tố cực kỳ quan trọng trong AI Agent vì tốc độ phản hồi ảnh hưởng trực tiếp đến trải nghiệm người dùng cuối.

Giới hạn thực tế:

- Llama 3.3 70B: 14.400 req/ngày, 30 RPM

- Llama 3.1 8B: tốc độ cao hơn, limit rộng hơn

- Mixtral 8x7B, Gemma cũng có sẵn

Phù hợp nhất cho: Tool routing trong agent (phân loại nhanh yes/no), voice assistant (latency thấp), real-time chatbot, các bước lặp nhiều lần trong agentic loop.

Lưu ý quan trọng: Groq thường bị lỗi 429 (rate limit) khi prompt dài hoặc conversation history quá lớn. Để tránh lỗi giới hạn, hãy giữ phần hướng dẫn hệ thống (system prompt) ngắn gọn và thêm khoảng nghỉ giữa các vòng lặp.

3. OpenRouter

Link: openrouter.ai

OpenRouter là gateway tổng hợp API, cho phép bạn truy cập hơn 30 model miễn phí (đánh dấu bằng hậu tố :free) chỉ với một API key duy nhất. Đây là lựa chọn lý tưởng để A/B test model hoặc xây dựng agent có thể chuyển đổi provider linh hoạt.

Các model miễn phí nổi bật (tháng 5/2026):

- meta-llama/llama-4-maverick:free

- deepseek/deepseek-r1:free

- qwen/qwen3-235b-a22b:free

- mistralai/mistral-7b-instruct:free

Giới hạn thực tế:

- 50 req/ngày khi không có số dư

- 1.000 req/ngày nếu tài khoản có từ $10 trở lên

- 20 RPM trên free models

Phù hợp nhất cho: Thử nghiệm so sánh nhiều mô hình cùng lúc hoặc làm phương án dự phòng khi các nhà cung cấp khác hết hạn mức.

Lưu ý: Model miễn phí trên OpenRouter có thể thay đổi tính sẵn có mà không báo trước. Nên kiểm tra danh sách model :free mới nhất tại trang model của OpenRouter trước khi deploy.

4. Cerebras

Link: inference.cerebras.ai

Cerebras dùng chip Wafer-Scale Engine (WSE) — một kiến trúc phần cứng hoàn toàn khác GPU — để đạt tốc độ 1.800+ token/giây. Điểm nổi bật của free tier Cerebras là 1 triệu token mỗi ngày, phù hợp cho các pipeline xử lý hàng loạt.

Giới hạn thực tế:

- 1.000.000 token/ngày

- 30 RPM, 60.000–100.000 token/phút

- Context window: 8.192 token (giới hạn tạm thời trên free tier)

Phù hợp nhất cho: Batch processing (phân loại dữ liệu, tạo nội dung hàng loạt), content pipeline, automation không cần context dài.

Lưu ý: Context 8K token là điểm yếu lớn, không phù hợp cho phân tích tài liệu dài hoặc agent có conversation history nhiều vòng.

5. NVIDIA NIM

Link: build.nvidia.com

NVIDIA NIM (NVIDIA Inference Microservices) cung cấp hơn 40 model miễn phí, không chỉ là language model mà còn bao gồm vision, embedding, và các model domain-specific (sinh học phân tử, phân tích ảnh y tế…). Đây là nền tảng phù hợp nhất khi bạn cần thử nghiệm nhiều loại model khác nhau.

Xem thêm: Cách dùng API miễn phí với NVIDIA AI

Giới hạn thực tế:

- ~40 RPM khi không có thẻ tín dụng

- 1.000 credits miễn phí khi đăng ký (có thể xin thêm đến 4.000)

- Hỗ trợ Llama, DeepSeek R1/V3, Kimi K2.5, và nhiều model khác

Phù hợp nhất cho: Thử nghiệm các mô hình đa phương thức hoặc kết hợp LLM với mô hình nhúng (embedding).

6. SambaNova Cloud

Link: cloud.sambanova.ai

SambaNova dùng chip RDU (Reconfigurable Dataflow Unit) để cung cấp tốc độ cao trên các model rất lớn như Llama 3.1 405B — điều hiếm thấy ở free tier. Nền tảng này có free tier vĩnh viễn (không phải trial) ngoài $5 credit ban đầu (hết hạn sau 30 ngày).

Giới hạn thực tế:

- Llama 3.1 405B: 10 RPM

- Llama 3.1 8B: 30 RPM

- Qwen 2.5 72B cũng có sẵn miễn phí

Phù hợp nhất cho: Các tác vụ yêu cầu khả năng suy luận phức tạp và chuyên sâu.

7. Mistral La Plateforme

Link: console.mistral.ai

Mistral cung cấp free tier với 1 tỷ token mỗi tháng trên tất cả model Mistral (Small, Large, Embed). Đây là lựa chọn nổi bật cho RAG pipeline vì bạn có cả generation và embedding model trên cùng một tài khoản miễn phí.

Giới hạn thực tế:

- 1B token/tháng (tổng cộng tất cả model)

- ~2 RPM (khá thấp — cần tính toán cẩn thận)

- Codestral miễn phí riêng dành cho code generation

Phù hợp nhất cho: Xây dựng hệ thống RAG hoàn chỉnh hoặc hỗ trợ viết mã nguồn.

8. Cloudflare Workers AI

Link: developers.cloudflare.com/workers-ai

Cloudflare Workers AI chạy inference tại edge network của Cloudflare — nghĩa là model được thực thi gần người dùng địa lý, giảm latency đáng kể. Phù hợp cho các agent cần phản hồi nhanh cho người dùng toàn cầu.

Giới hạn thực tế:

- 10.000 “neurons”/ngày (đơn vị tính của Cloudflare)

- 300 RPM

- 47+ model bao gồm Llama, Gemma, Mistral, Stable Diffusion

Phù hợp nhất cho: Serverless AI agent, ứng dụng toàn cầu cần latency thấp, agent tích hợp sẵn trong hệ sinh thái Cloudflare Workers.

9. GitHub Models

Link: github.com/marketplace/models

GitHub Models cho phép truy cập nhiều model từ OpenAI, Meta, Google, và các nhà cung cấp khác thông qua GitHub token. Đây là cách duy nhất để dùng GPT-4o qua API mà không cần thẻ tín dụng hay trả phí cho OpenAI.

Giới hạn thực tế:

- ~150 req/ngày với GPT-4o (tùy gói GitHub/Copilot)

- 50 chat + 2.000 completions mỗi tháng (free GitHub account)

- Bao gồm Llama 4, Gemma, Phi-4 và nhiều model khác

Phù hợp nhất cho: Developer đã có tài khoản GitHub muốn thử GPT-4o, so sánh nhiều model qua một giao diện, tạo nguyên mẫu (prototype) nhanh.

10. Cohere

Link: dashboard.cohere.com

Cohere cung cấp bộ ba hoàn chỉnh cho RAG pipeline: Command R+ (generation), Embed 4 (embeddings), và Rerank 3.5 (reranking) — tất cả trên cùng một free tier. Đây là điểm cực mạnh so với các provider khác.

Giới hạn thực tế:

- 1.000 req/tháng (tổng)

- Free tier mirror production API — code không cần sửa khi upgrade

Phù hợp nhất cho: Xây dựng hệ thống tìm kiếm và trả lời dựa trên tài liệu doanh nghiệp.

11. Hugging Face Inference API

Link: huggingface.co

Hugging Face cung cấp API inference cho hàng nghìn model từ cộng đồng — nhiều hơn bất kỳ provider nào khác. Free tier khá hạn chế về rate limit, nhưng đây là nơi duy nhất bạn tìm thấy các model fine-tune chuyên biệt không có ở nơi khác.

Giới hạn thực tế:

- Rate limit nghiêm ngặt, thường không ổn định

- Phù hợp cho thử nghiệm, không phải production

- Serverless Inference API tốt hơn cho các model phổ biến

Phù hợp nhất cho: Nghiên cứu và thử nghiệm các mô hình chuyên biệt cho từng bài toán cụ thể.

12. Fireworks AI

Link: fireworks.ai

Fireworks AI chuyên tối ưu inference cho các open-source model như Llama 3.1 405B và DeepSeek R1. Free tier không cần thẻ (10 RPM) đủ để prototype, và khi thêm thông tin thanh toán limit tăng lên 6.000 RPM.

Giới hạn thực tế:

- 10 RPM không cần thẻ

- Model: Llama 3.1 405B, DeepSeek R1/V3, Mixtral

Phù hợp nhất cho: Các tác vụ cần gọi hàm (function calling) hoặc trích xuất dữ liệu chính xác.

Bảng so sánh nhanh:

Provider Model nổi bật (miễn phí) Giới hạn miễn phí Cần thẻ tín dụng? Google AI Studio Gemini 2.5 Flash 1.500 req/ngày, 1M ctx Không Groq Llama 3.3 70B 14.400 req/ngày, 300+ TPS Không OpenRouter 30+ models (:free) 50 req/ngày (1K nếu nạp $10) Không Cerebras Llama 3.3 70B 1M token/ngày Không NVIDIA NIM 40+ models ~40 req/phút Không SambaNova Llama 3.3 70B, 405B 10–30 RPM Không Mistral La Plateforme Mistral Small/Large 1B token/tháng Không Cloudflare Workers AI Llama, Gemma… 10.000 neurons/ngày Không GitHub Models GPT-4o, Llama, Gemma 50 chat + 2K completions/tháng Không Cohere Command R+ 1.000 req/tháng Không Hugging Face Inference Hàng nghìn models Rất hạn chế, miễn phí Không Fireworks AI Llama, DeepSeek 10 RPM (không thẻ) Không

Kết luận

Việc lựa chọn đúng nhà cung cấp LLM API miễn phí không chỉ giúp tối ưu hóa chi phí mà còn tạo nền tảng vững chắc cho quá trình vận hành AI Agent. Hãy bắt đầu đăng ký một API Key phù hợp, cấu hình trực tiếp vào dự án hiện tại và trải nghiệm tốc độ xử lý ưu việt của hệ thống. Đừng quên lưu lại danh sách này để luôn có phương án dự phòng hiệu quả cho các tác vụ lập trình sắp tới.

Những câu hỏi thường gặp

OpenAI có cung cấp API key miễn phí không?

Tính đến năm 2026, OpenAI không còn cấp credit dùng thử miễn phí tự động. Tài khoản mới cần nhập thông tin thẻ tín dụng mới có thể gọi API. Nếu cần API tương thích OpenAI format hoàn toàn miễn phí, Groq và OpenRouter là lựa chọn thay thế tốt nhất.

Dữ liệu gửi qua API miễn phí có bị dùng để train model không?

Chính sách khác nhau theo provider: Google AI Studio có thể dùng dữ liệu free tier để cải thiện model (trừ khi bạn opt-out trong cài đặt). Groq và Cerebras thường không train trên dữ liệu của người dùng. OpenRouter tuân theo chính sách của từng provider model. Với dữ liệu nhạy cảm, hãy đọc kỹ Privacy Policy hoặc dùng self-hosted model qua Ollama.

Có thể dùng nhiều provider cùng lúc trong một agent không?

Hoàn toàn có thể. Vì tất cả provider trong danh sách này đều tương thích OpenAI SDK format (chỉ cần đổi base_url và api_key), việc xây dựng routing layer rất đơn giản.

Ollama và self-hosted model có nên dùng song song không?

Rất nên. Ollama cho phép chạy model cục bộ hoàn toàn miễn phí và không giới hạn, phù hợp làm fallback cuối cùng khi tất cả free tier API đều hết quota. Nhược điểm là cần phần cứng đủ mạnh (ít nhất 16GB RAM cho model 7B, 32GB+ cho 70B) và tốc độ thường chậm hơn cloud provider.

![Cách dùng API miễn phí với NVIDIA AI [2026]](https://tino.vn/blog/wp-content/uploads/2026/05/dung-api-mien-phi-voi-nvidia-ai-cover-150x150.png)

![Cách dùng API miễn phí với NVIDIA AI [2026]](https://tino.vn/blog/wp-content/uploads/2026/05/dung-api-mien-phi-voi-nvidia-ai-cover-260x176.png)