Bạn muốn trải nghiệm AI ngay trên máy tính của mình mà không cần internet, không lo dữ liệu bị rò rỉ, không tốn phí thuê bao hàng tháng? Đó chính xác là điều mà LM Studio mang lại. Với LM Studio, bạn có thể tải các mô hình như Llama, Qwen, Gemma, DeepSeek, gpt-oss, Mistral và sử dụng ngay trong giao diện chat quen thuộc. Vậy cụ thể LM Studio là gì? Cùng Tino tìm hiểu cách cài đặt và sử dụng LM Studio qua bài viết dưới đây nhé!

Tổng quan về LM Studio

LM Studio là gì?

LM Studio là phần mềm cho phép người dùng tải, quản lý và chạy các mô hình ngôn ngữ lớn ngay trên máy tính cá nhân. Thay vì gửi dữ liệu lên máy chủ của bên thứ ba, bạn có thể xử lý nhiều tác vụ AI trực tiếp trên thiết bị đang sử dụng.

Hiểu đơn giản, LM Studio giống như một “trung tâm điều khiển AI local”. Bạn mở phần mềm, chọn mô hình AI phù hợp, tải về máy, sau đó trò chuyện với AI qua giao diện thân thiện. Người không rành kỹ thuật vẫn có thể bắt đầu bằng các thao tác bấm chọn, tải model và nhập câu hỏi như khi dùng chatbot thông thường.

Theo tài liệu chính thức, LM Studio hỗ trợ tải và chạy các local LLM như gpt-oss, Llama, Qwen; cung cấp giao diện chat, tìm kiếm và tải model qua Hugging Face, chạy model qua endpoint tương thích OpenAI, quản lý model, prompt và cấu hình.

LM Studio tương thích với Windows 10 trở lên, macOS 14 trở lên (chỉ dành cho chip Apple Silicon) và Linux, với khả năng tăng tốc GPU thông qua CUDA, Metal, Vulkan và ROCm.

LM Studio dùng để làm gì?

LM Studio có thể phục vụ nhiều mục đích khác nhau, từ cơ bản đến nâng cao.

- Người dùng thông thường muốn có trợ lý AI riêng tư, không lo bị theo dõi

- Lập trình viên cần API local tương thích OpenAI để tích hợp vào dự án

- Nhà nghiên cứu muốn thử nghiệm các mô hình AI khác nhau mà không tốn chi phí cloud

- Doanh nghiệp cần xử lý tài liệu nội bộ nhạy cảm mà không muốn dữ liệu ra ngoài.

Ưu điểm nổi bật của LM Studio

- Dễ sử dụng với người mới: LM Studio có giao diện trực quan, cho phép tìm kiếm model, tải model và chat trực tiếp. Người dùng không cần viết lệnh phức tạp ở giai đoạn đầu.

- Tăng tính riêng tư dữ liệu: Khi chạy model local, nhiều dữ liệu có thể được xử lý ngay trên máy tính cá nhân.

- Hỗ trợ nhiều mô hình AI phổ biến: Trang chủ LM Studio giới thiệu khả năng dùng local LLM như gpt-oss, Qwen3, Gemma3, DeepSeek và nhiều model khác trên phần cứng cá nhân.

- Có thể dùng như local API server: LM Studio cho phép bật local server. Tính năng này giúp ứng dụng khác gọi model local qua API tương thích OpenAI.

- Phù hợp cho thử nghiệm AI Agent: Nhờ MCP, API, SDK và CLI, LM Studio không chỉ là phần mềm chat AI local. Công cụ này còn có thể trở thành nền tảng thử nghiệm AI Agent, trợ lý nội bộ hoặc ứng dụng AI riêng cho cá nhân và doanh nghiệp.

Vì sao LM Studio phù hợp với xu hướng AI Agent?

AI Agent là hệ thống AI có khả năng nhận mục tiêu, phân tích nhiệm vụ, gọi công cụ và thực hiện nhiều bước xử lý thay vì chỉ trả lời một câu hỏi đơn lẻ. Trong bối cảnh này, LM Studio đóng vai trò như “bộ não local” cho các thử nghiệm agent.

LM Studio hỗ trợ local REST API, API tương thích OpenAI, SDK Python, SDK JavaScript, CLI và MCP Server. Các thành phần này giúp developer kết nối local model với ứng dụng, script, công cụ tự động hóa hoặc workflow AI Agent.

Đặc biệt, LM Studio đã hỗ trợ MCP Server từ phiên bản 0.3.17, cho phép kết nối local hoặc remote MCP Server để mở rộng khả năng của model. Tuy nhiên, tài liệu chính thức cũng cảnh báo người dùng không nên cài MCP Server từ nguồn thiếu tin cậy vì một số MCP có thể truy cập file cục bộ, chạy mã hoặc dùng kết nối mạng.

Hướng dẫn cài đặt và sử dụng LM Studio

Yêu cầu hệ thống để chạy LM Studio

Trước khi tải về, hãy kiểm tra máy tính của bạn có đáp ứng được không.

Mac

LM Studio trên Mac yêu cầu chip Apple Silicon (M1/M2/M3/M4). Các máy Mac dùng chip Intel hiện không được hỗ trợ. Bạn vẫn có thể chạy LM Studio trên Mac 8GB, nhưng nên giới hạn ở các mô hình nhỏ và context ngắn.

Windows và Linux

Đối với Windows và Linux, CPU cần hỗ trợ tập lệnh AVX2 (cho hệ thống x64). RAM tối thiểu được khuyến nghị là 16GB. GPU nên có ít nhất 4GB VRAM.

LM Studio trên Linux được phân phối dưới dạng AppImage. Các phiên bản Ubuntu mới hơn 22 chưa được kiểm tra kỹ.

Các bước cài đặt LM Studio

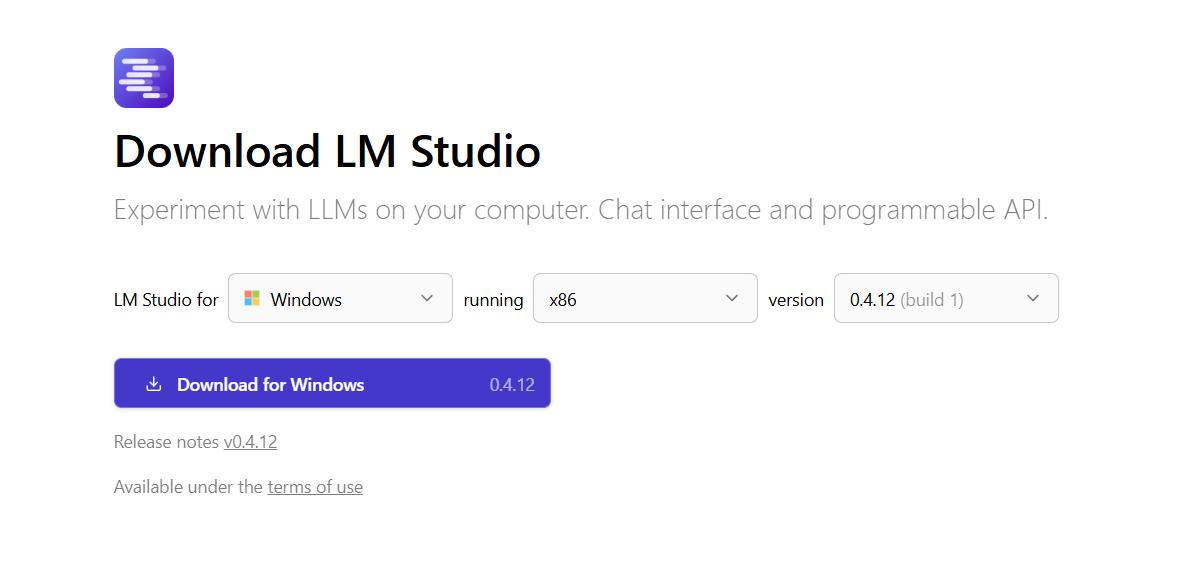

Bước 1: Tải LM Studio

Truy cập trang chủ lmstudio.ai/download. Website tự động nhận diện hệ điều hành của bạn và đề xuất phiên bản phù hợp cho Windows, Mac hoặc Linux.

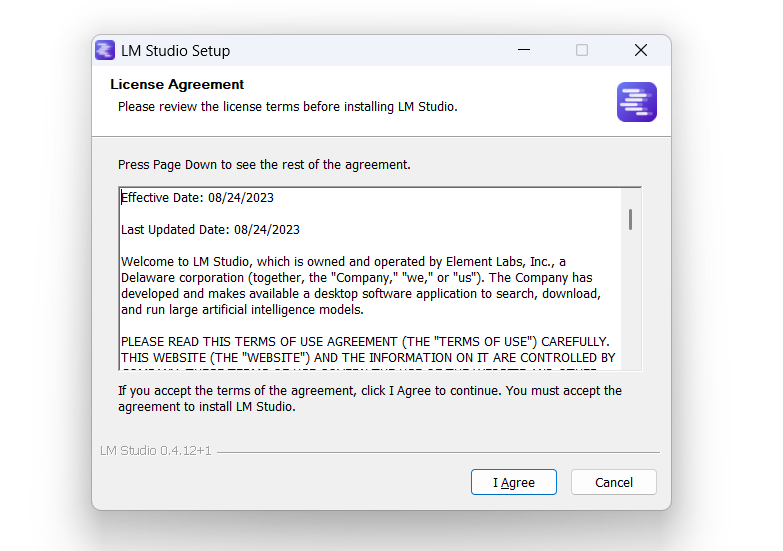

Bước 2: Cài đặt LM Studio

- Windows: Tải file .exe, chạy trình cài đặt như bình thường

- Mac: Tải file .dmg, kéo ứng dụng vào thư mục Applications

- Linux: Tải file .AppImage, cấp quyền thực thi rồi chạy

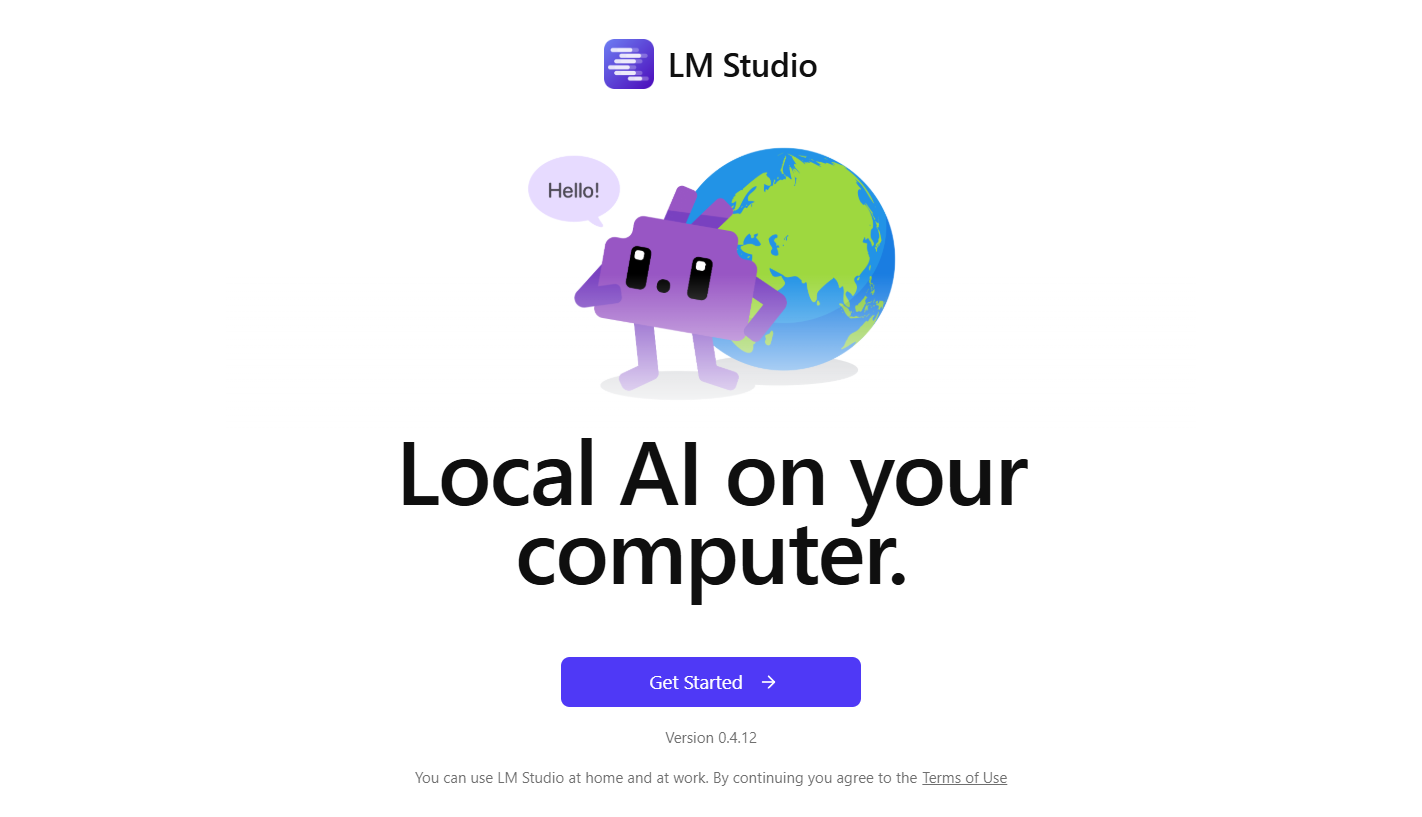

Nhấn Get Started để bắt đầu.

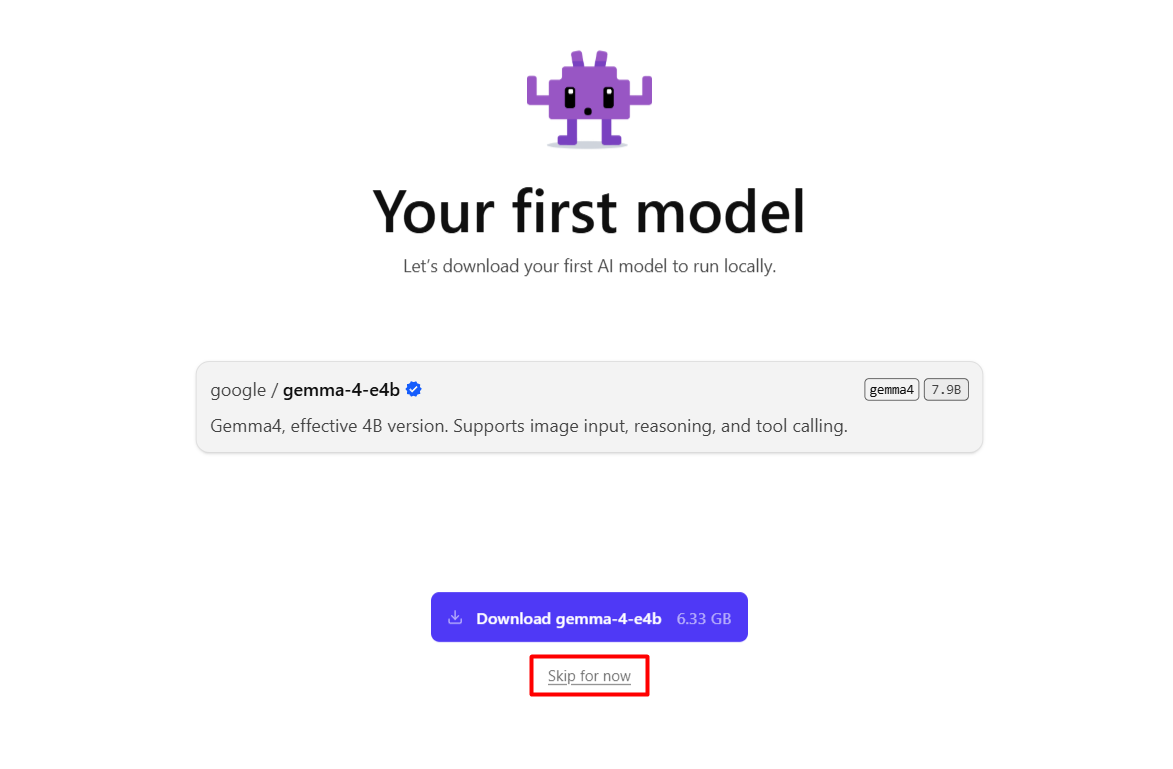

Bước 3: Khởi động lần đầu

Khi mở LM Studio lần đầu, bạn sẽ được gợi ý tải model đầu tiên. Bạn có thể nhấn Skip for now để bỏ qua.

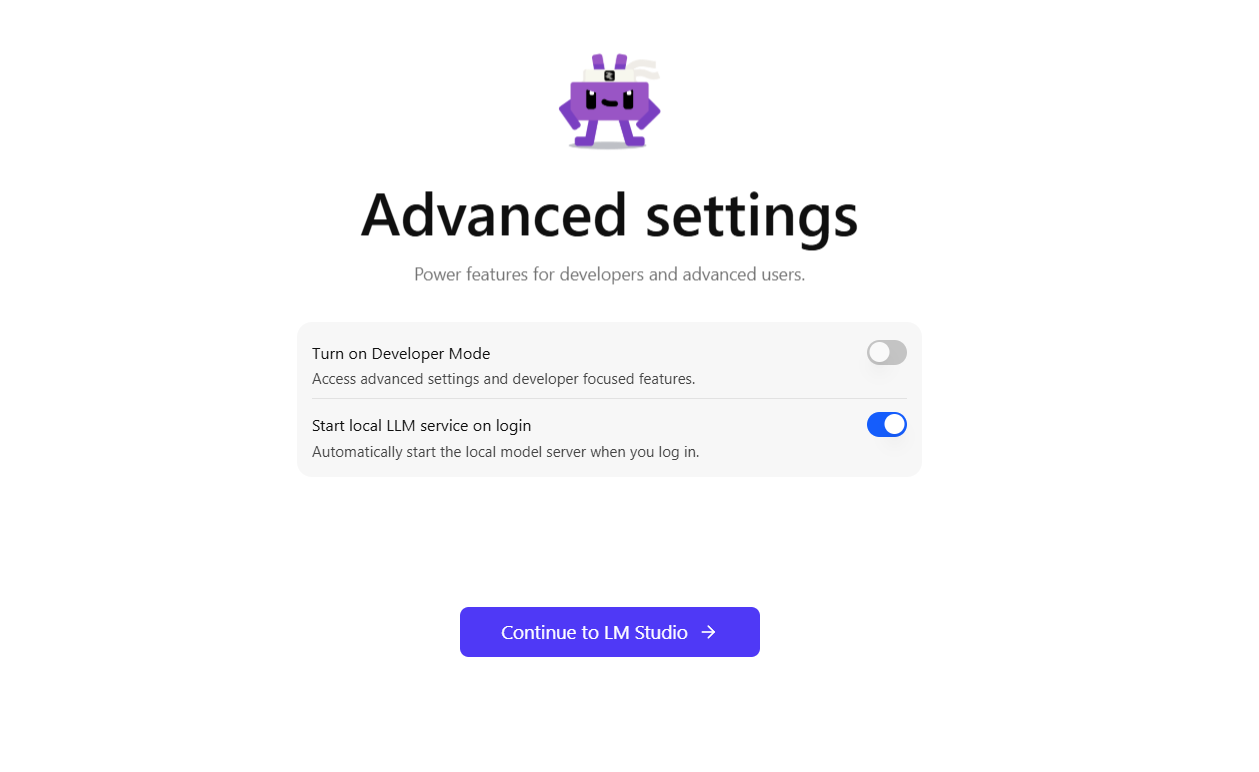

Giữ mặc định rồi nhấn Continue LM Studio để tiếp tục.

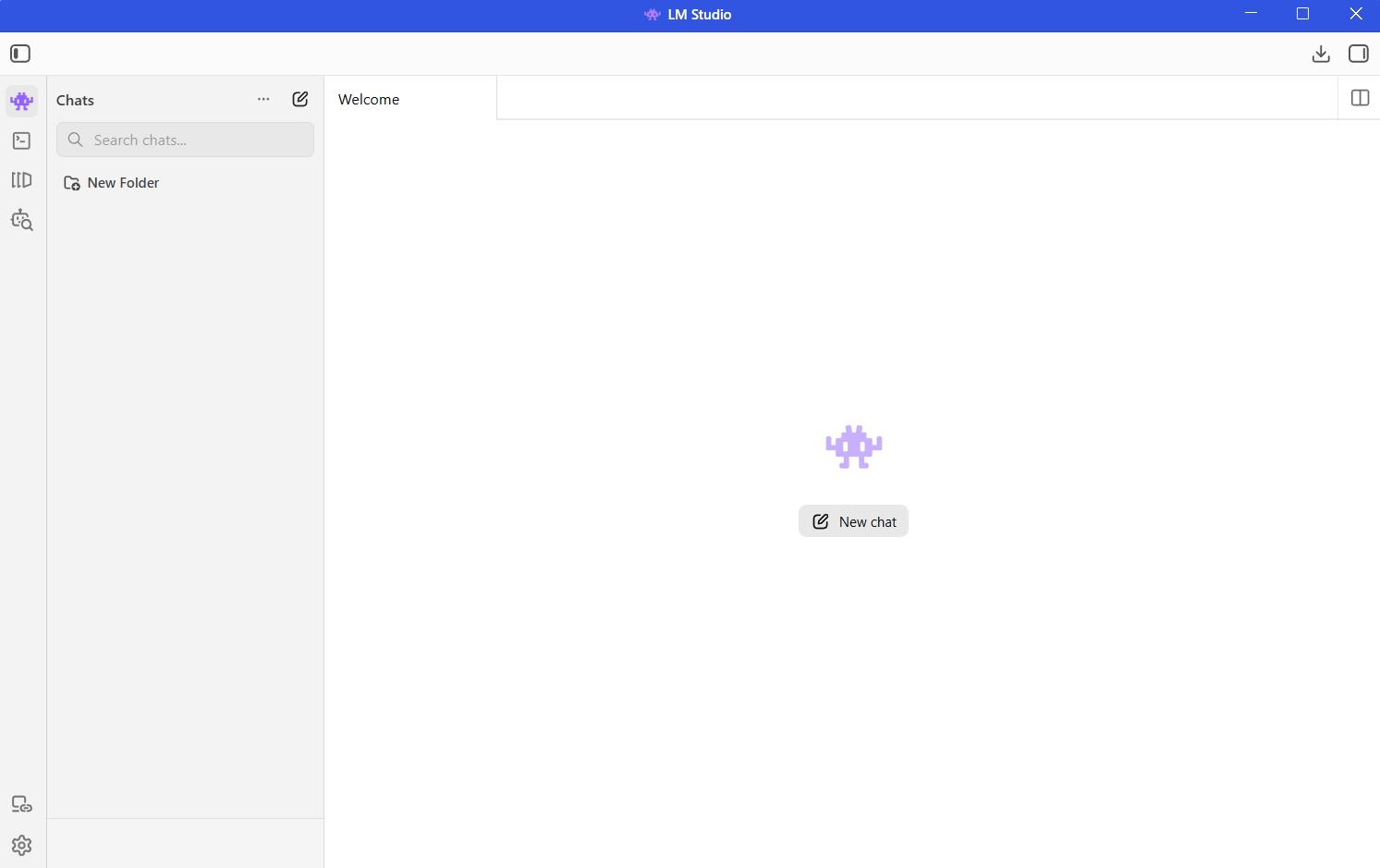

Đây là giao diện chính của LM Studio:

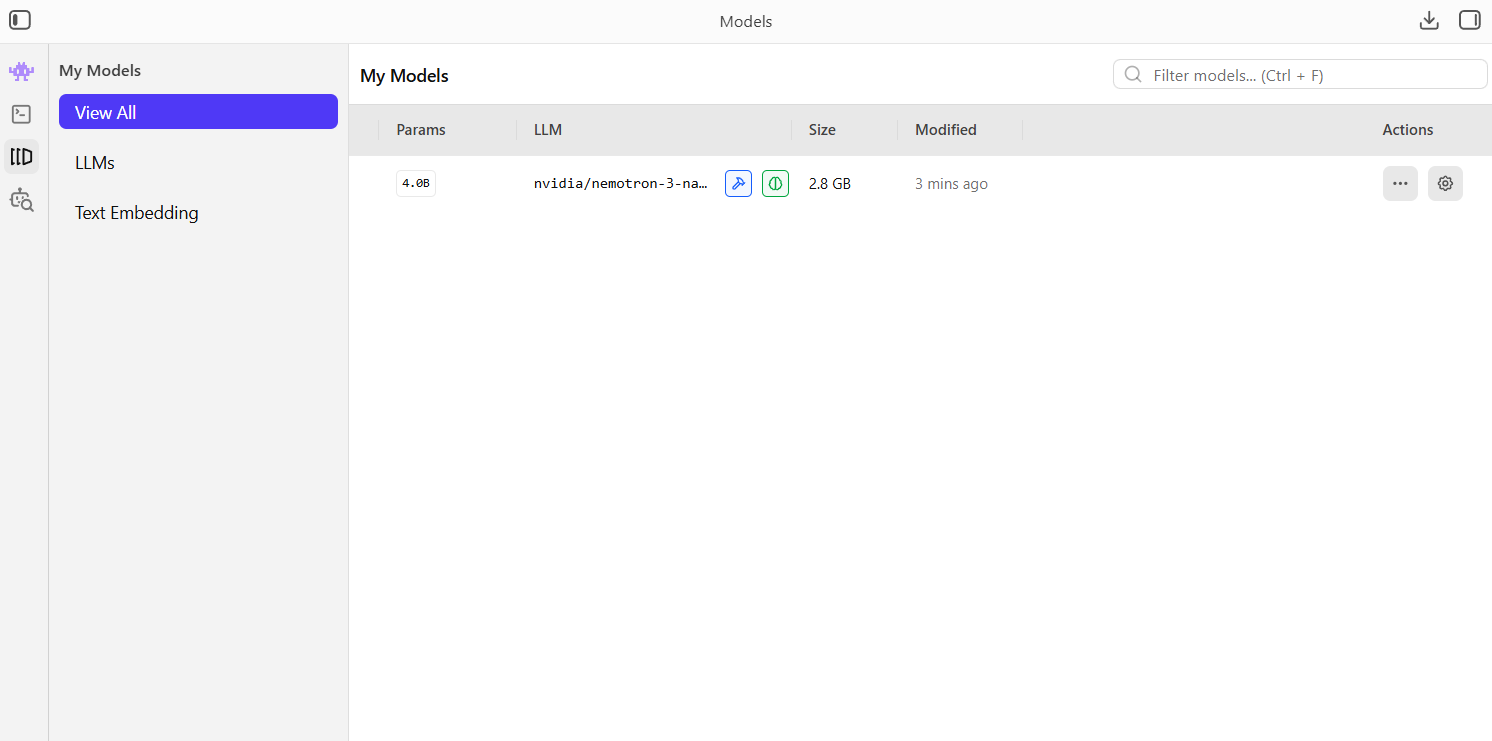

Phần My Model là nơi lưu trữ các model đã cài đặt:

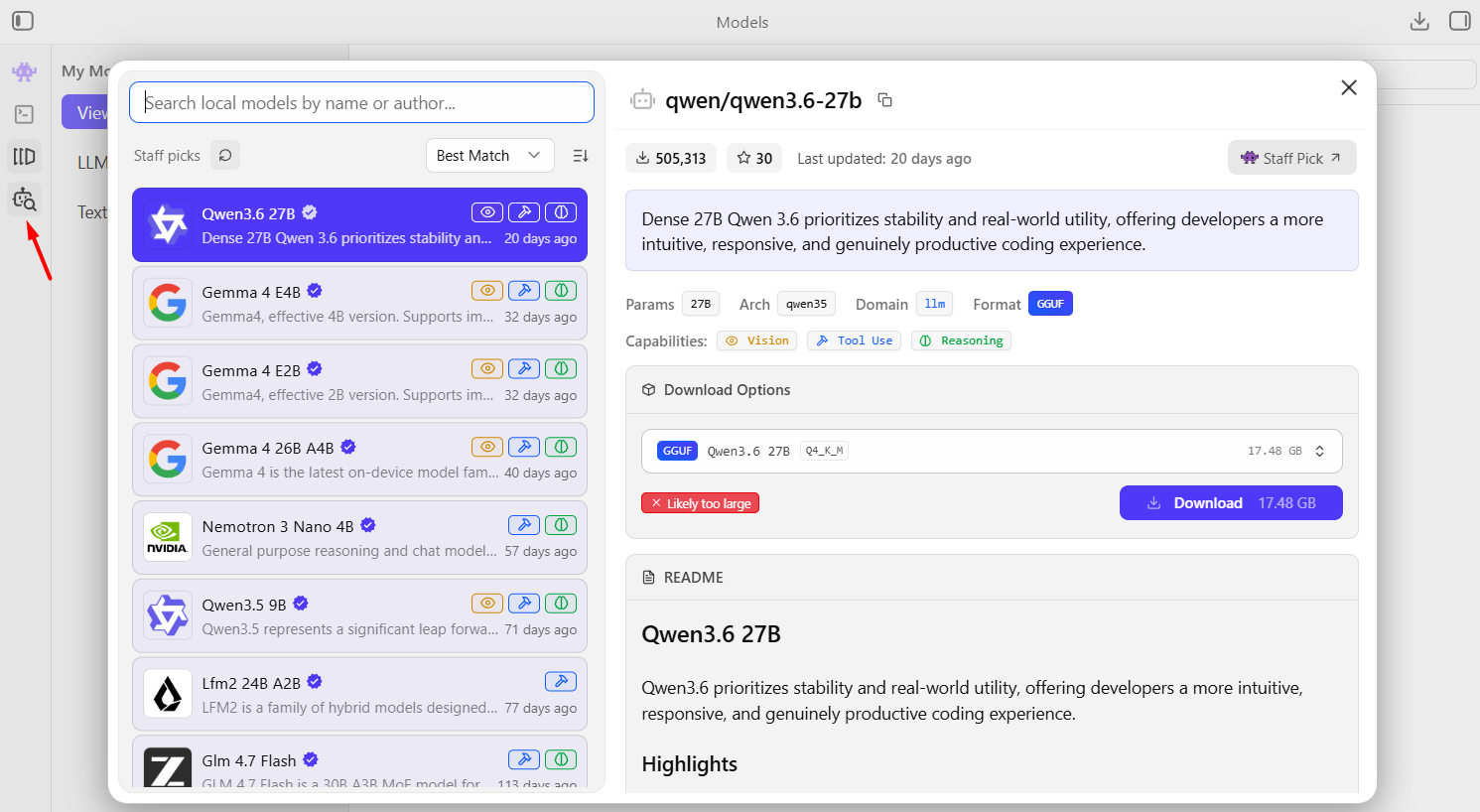

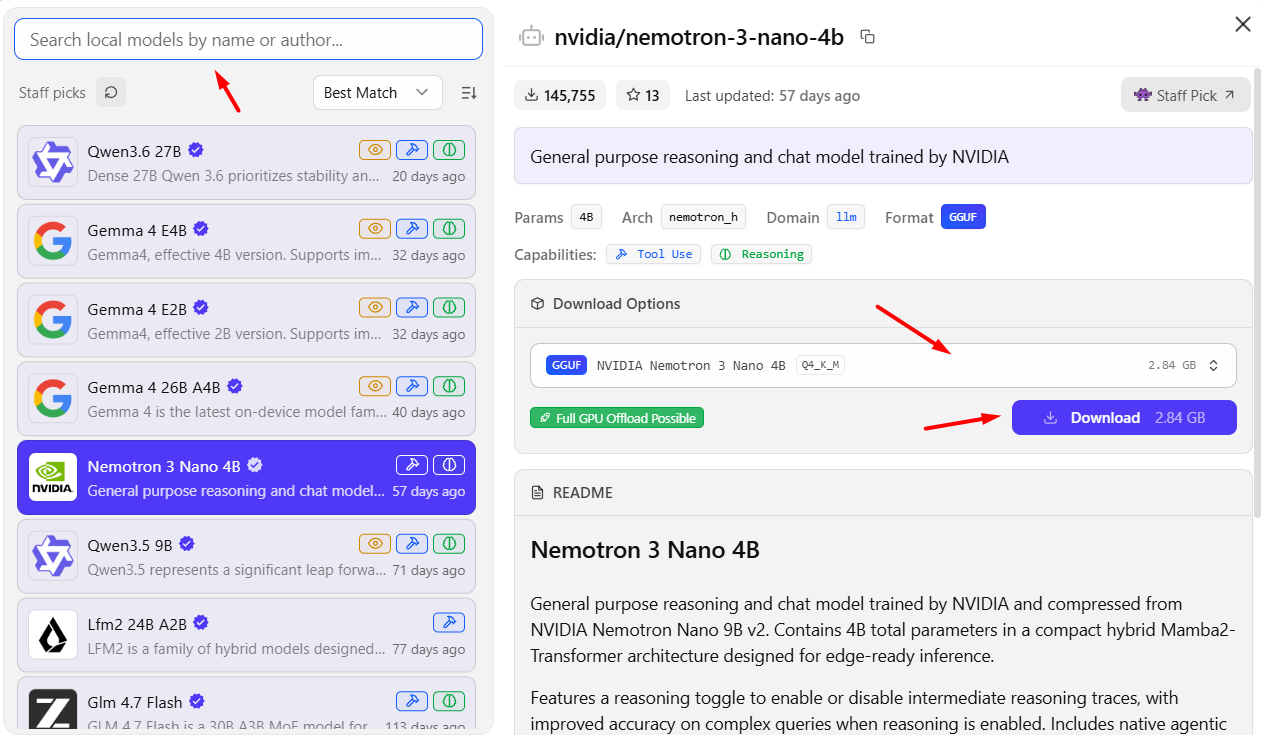

Bạn có thể tìm kiếm, khám phá và bắt đầu tải xuống model mới ngay lập tức bằng cách chuyển qua phần Model Search.

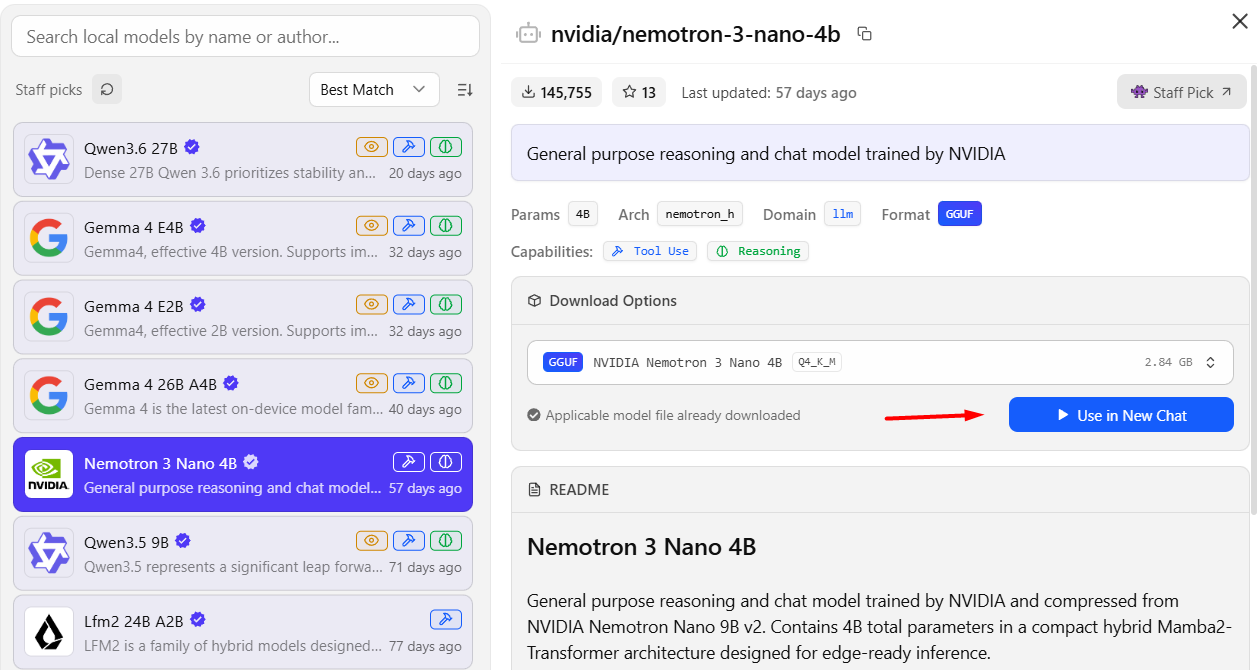

Bước 4: Tải mô hình AI

LM Studio tích hợp sẵn kho model từ Hugging Face, bạn không cần tìm kiếm ở đâu khác.

Sau khi vào mục Model Search, bạn nhấp vào biểu tượng Search ở thanh bên trái.

- Gõ tên mô hình muốn dùng, ví dụ: Qwen, Gemma, Llama, DeepSeek

- Chọn phiên bản phù hợp với RAM máy bạn

- Nhấn Download và chờ quá trình tải về hoàn tất

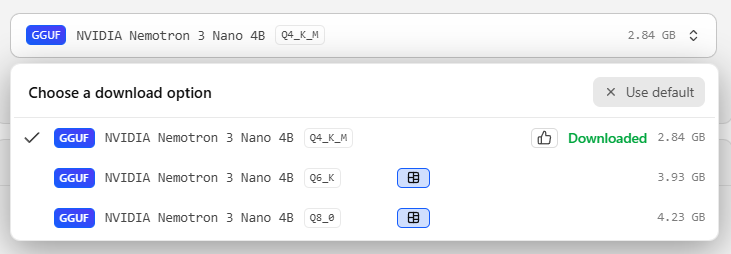

Hiểu về Quantization (Mức nén mô hình):

Quantization cho biết mức độ nén của mô hình. Q4_K_M là lựa chọn tốt nhất cho sự cân bằng giữa kích thước và chất lượng — hãy bắt đầu từ đây. Q6_K cho chất lượng tốt hơn một chút. Q8 gần với chất lượng gốc nhưng cần gần gấp đôi dung lượng so với Q4 (tùy model).

Hướng dẫn sử dụng các tính năng chính

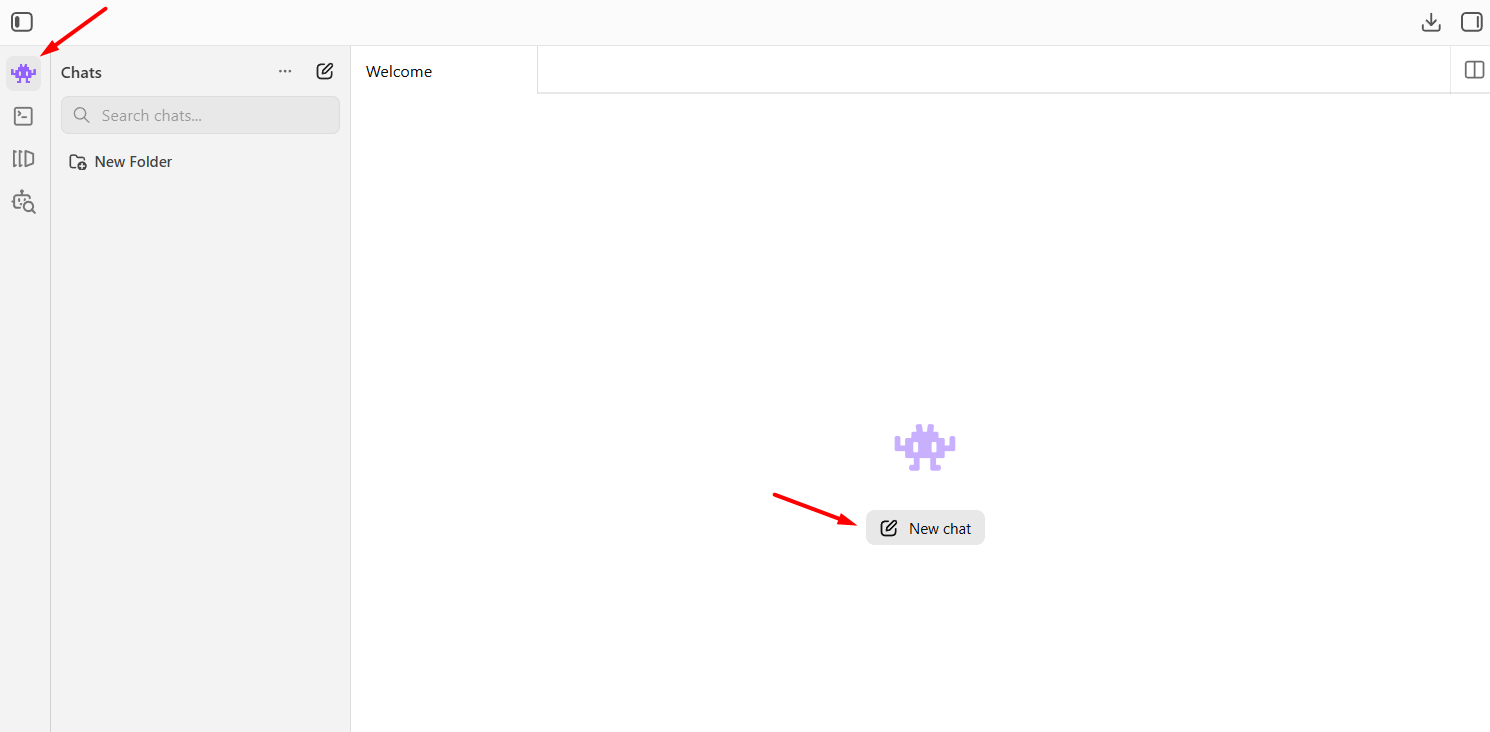

Tính Năng 1: Chat với AI

Sau khi tải model xong, bạn nhấn nút Use in new chat để bắt đầu sử dụng.

Hoặc vào tab Chat -> chọn New chat.

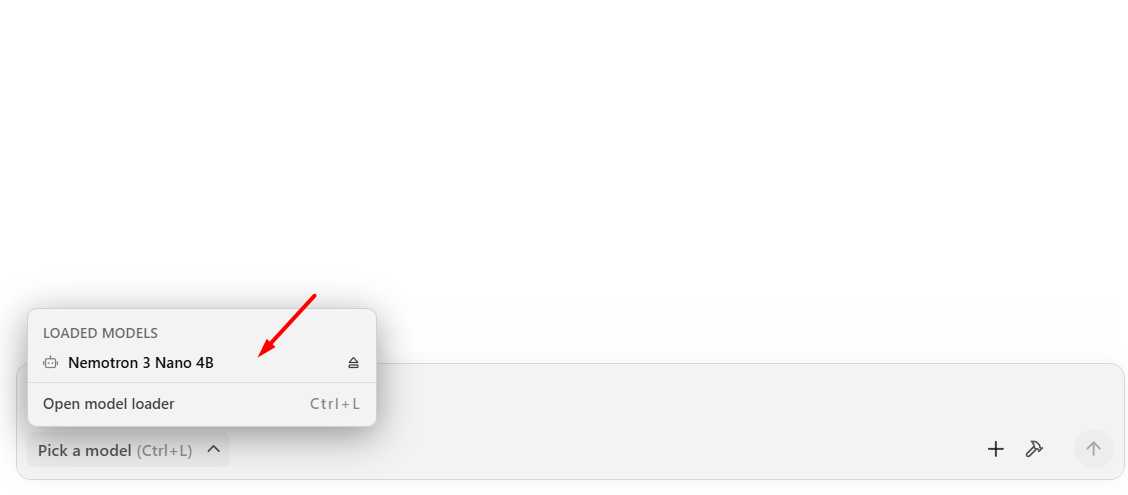

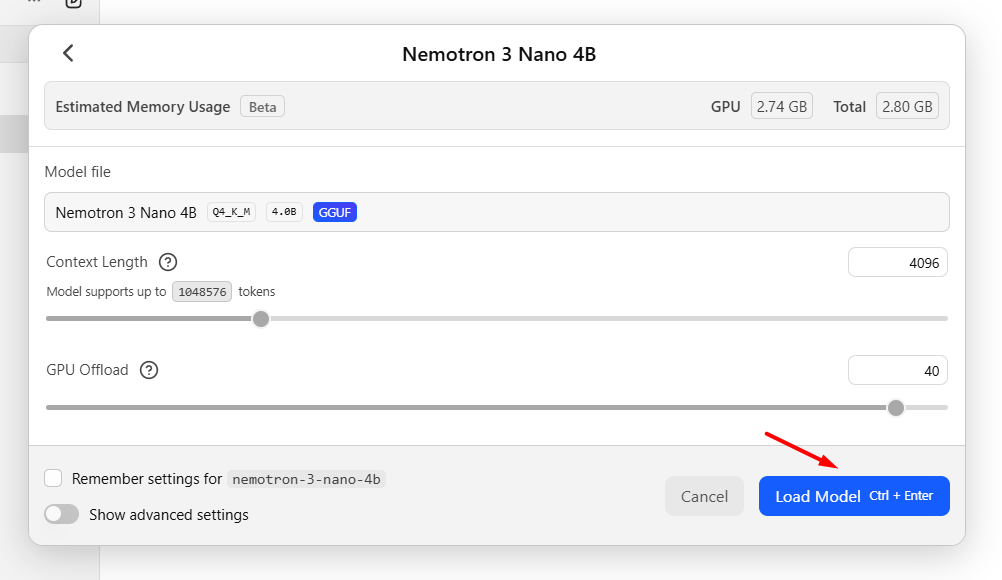

Chọn mô hình vừa tải, tùy chỉnh một vài thông số theo nhu cầu rồi nhấn Load Model.

Chờ trạng thái chuyển sang “Loaded” (có thể mất vài giây đến vài phút tùy kích thước mô hình).

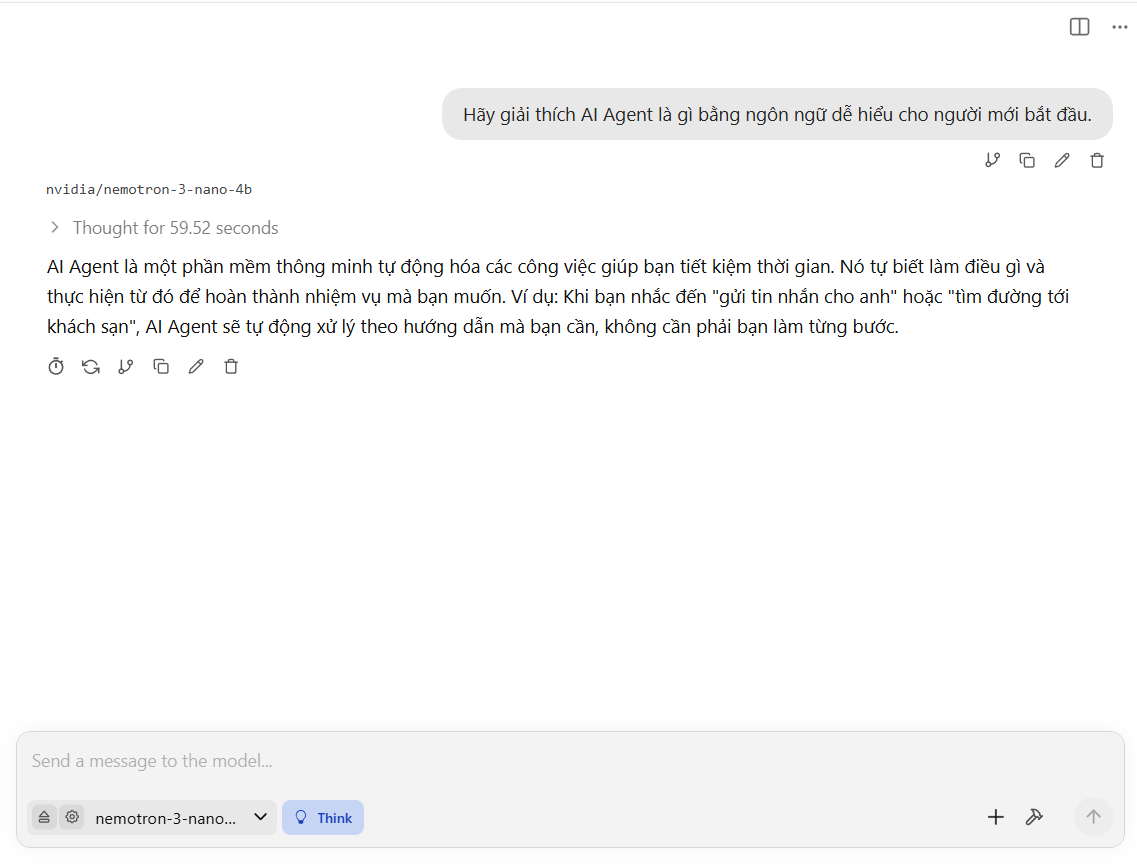

Bắt đầu gõ câu hỏi và nhấn Enter. Ví dụ:

Hãy giải thích AI Agent là gì bằng ngôn ngữ dễ hiểu cho người mới bắt đầu.

Bạn có thể tùy chỉnh System Prompt để định hình tính cách và chuyên môn của trợ lý AI. Ví dụ: “Bạn là chuyên gia về AI, hãy trả lời bằng tiếng Việt, ngắn gọn và thực tế.”

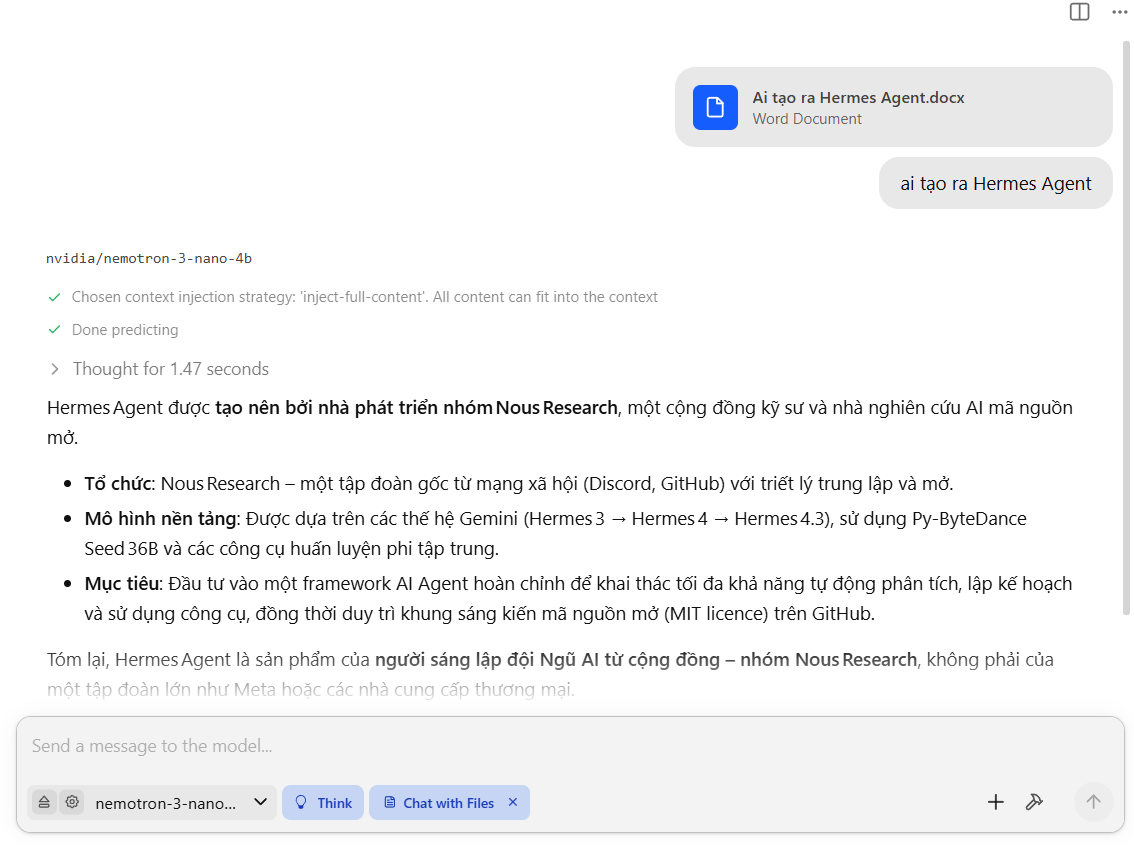

Tính năng 2: Chat với tài liệu

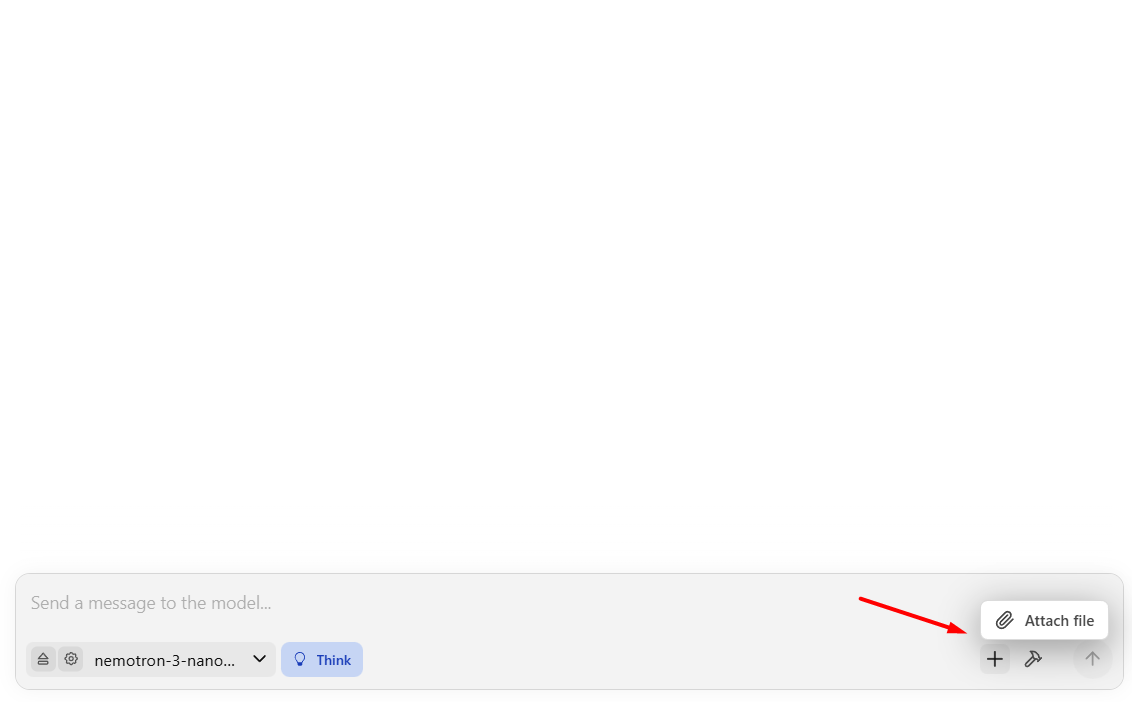

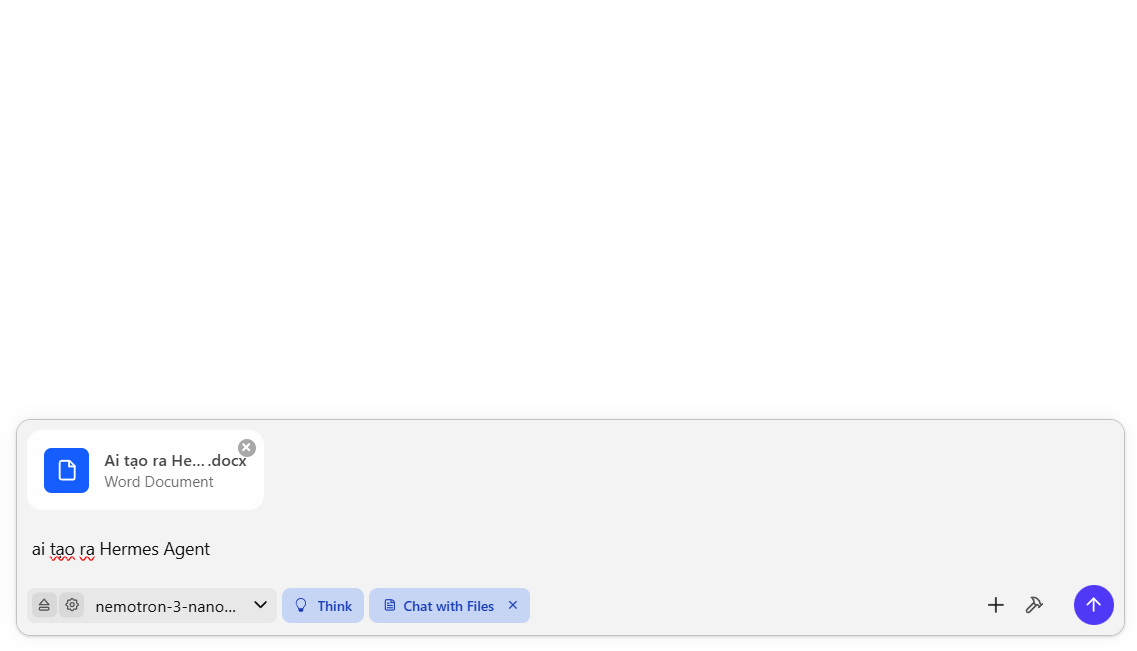

LM Studio tích hợp sẵn tính năng RAG (Retrieval-Augmented Generation) — nghĩa là bạn có thể “hỏi” tài liệu của mình.

Trong cửa sổ chat, nhấn vào biểu tượng Đính kèm file.

Tải lên PDF, DOCX, TXT hoặc các file văn bản khác và đặt câu hỏi về nội dung tài liệu đó.

Tính năng này cực kỳ hữu ích để tóm tắt hợp đồng dài, phân tích báo cáo hoặc trích xuất thông tin từ tài liệu nội bộ mà không lo dữ liệu bị gửi ra ngoài.

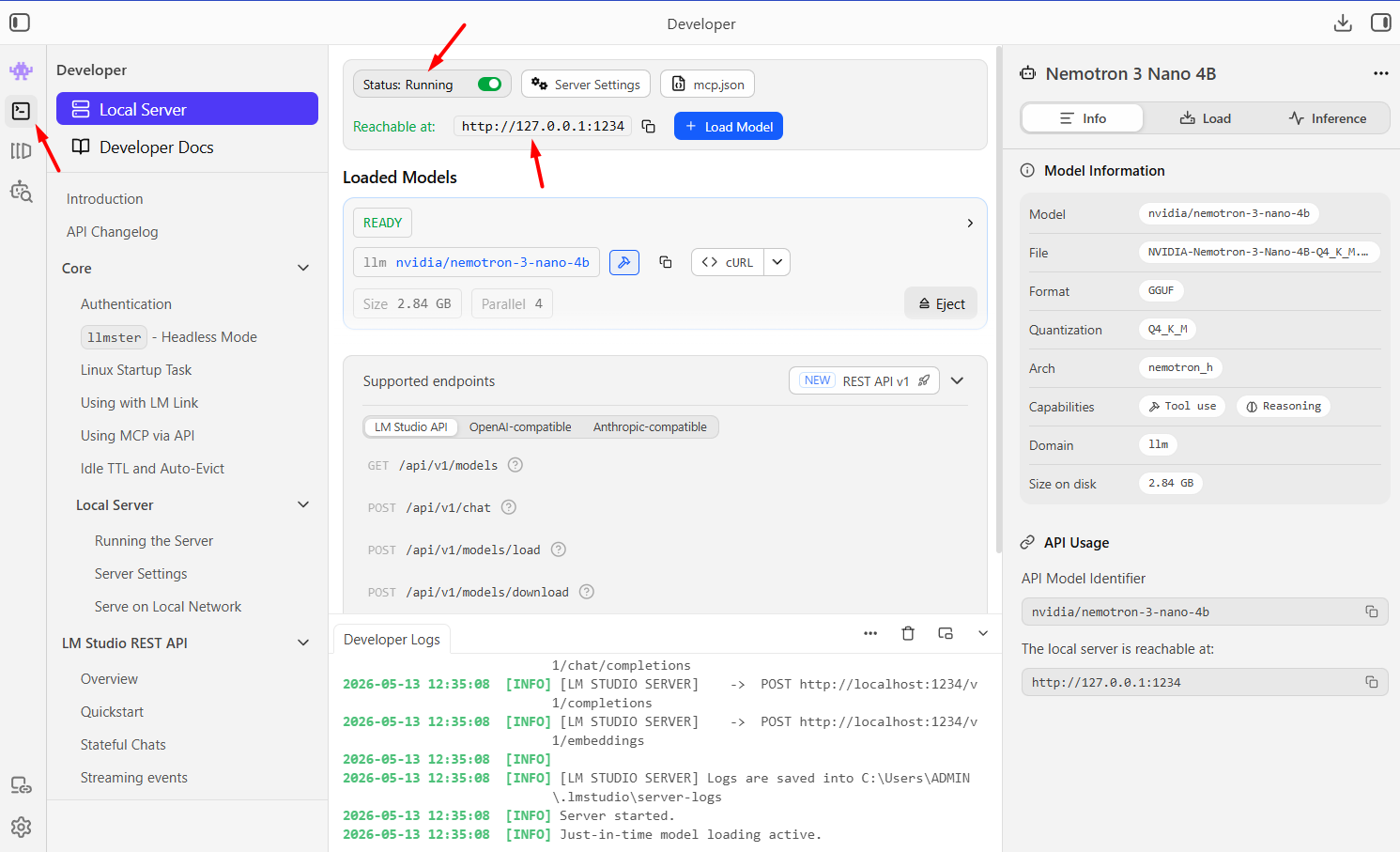

Tính năng 3: Local API Server (Dành cho lập trình viên)

LM Studio có thể chạy như một máy chủ API local tuân theo định dạng OpenAI API. Bạn có thể kết nối nó với các script, ứng dụng hoặc công cụ khác đang chạy trên máy.

Cách bật:

- Vào tab Developer (biểu tượng </> ở thanh bên)

- Nhấn Start Running

- Server sẽ chạy tại http://localhost:1234

Sau đó, bạn có thể dùng bất kỳ thư viện tương thích OpenAI nào để gọi mô hình local — thay api.openai.com bằng localhost:1234 là xong.

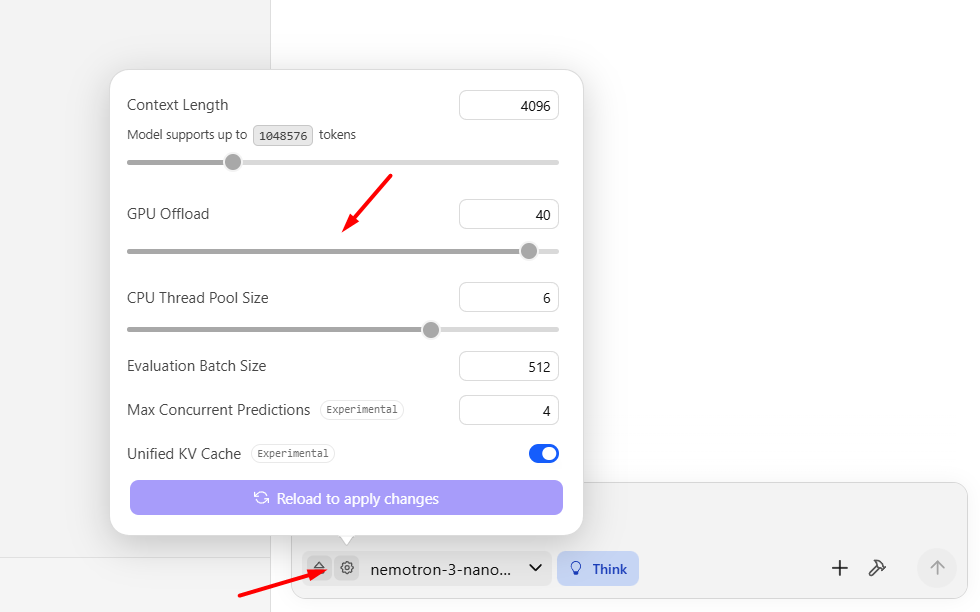

Tính năng 4: GPU Offloading — Tối ưu tốc độ

GPU offloading kiểm soát số lớp transformer của mô hình chạy trên GPU thay vì CPU. Nhiều lớp trên GPU đồng nghĩa với tốc độ nhanh hơn. Sự chênh lệch là rất lớn: mô hình chạy hoàn toàn trong VRAM có thể đạt 40+ token/giây, trong khi cùng mô hình đó nếu phải dùng RAM hệ thống chỉ đạt 1–2 token/giây — chậm hơn đến 30 lần.

Trong giao diện chat, khi chọn mô hình để tải, bạn nhấn nút Cài đặt và kéo thanh trượt GPU Offload từ 0–100%. Kéo lên tối đa nếu GPU của bạn có đủ VRAM.

Tính năng 5: LM Link — Kết nối từ xa

Tính năng LM Link cho phép kết nối đến các phiên bản LM Studio từ xa, tải mô hình và sử dụng như thể chúng đang chạy local, với mã hóa đầu cuối thông qua Tailscale.

Điều này có nghĩa là bạn có thể cài LM Studio trên máy tính mạnh ở nhà, rồi kết nối vào từ laptop nhỏ hơn khi ra ngoài — mô hình chạy trên máy mạnh, bạn chỉ cần gửi/nhận kết quả.

Xem thêm hướng dẫn tại: https://lmstudio.ai/docs/lmlink

Mẹo sử dụng LM Studio hiệu quả

Một số mẹo tối ưu: Dùng quantization 4-bit (Q4_K_M) để tiết kiệm VRAM với mức giảm chất lượng tối thiểu; bật GPU Offload hoàn toàn trong cài đặt để đạt tốc độ cao nhất; giữ context window dưới 8K token với mô hình 7B trên GPU 8GB VRAM.

Thêm một số mẹo thực tế khác:

- Bắt đầu với mô hình nhỏ: Thử mô hình 3B–7B trước, cảm nhận tốc độ, rồi mới nâng lên mô hình lớn hơn

- Lưu System Prompt hay dùng: LM Studio cho phép lưu các prompt mẫu để tái sử dụng

- Theo dõi RAM: Mở Task Manager (Windows) hoặc Activity Monitor (Mac) để xem mức dùng bộ nhớ

- Tắt ứng dụng nặng: Đóng trình duyệt, phần mềm chỉnh ảnh/video khi chạy mô hình lớn

Kết luận

LM Studio đang thay đổi cách người dùng tiếp cận trí tuệ nhân tạo. thay vì phụ thuộc vào dịch vụ đám mây tốn phí và lo ngại về quyền riêng tư, bạn hoàn toàn có thể tự chủ với một “ChatGPT riêng” ngay trên máy tính của mình. Dù bạn chỉ muốn có trợ lý AI cá nhân, hay đang xây dựng ứng dụng tích hợp AI cho doanh nghiệp, LM Studio đều là điểm khởi đầu lý tưởng.

Những câu hỏi thường gặp

LM Studio khác Ollama ở điểm gì?

Cả hai đều cho phép chạy LLM local, nhưng hướng đến đối tượng khác nhau. LM Studio ưu tiên giao diện trực quan, phù hợp với người không rành kỹ thuật. Ollama thiên về dòng lệnh, phù hợp hơn với lập trình viên muốn tự động hóa và tích hợp sâu. Nhiều người dùng cả hai song song tùy mục đích.

Làm sao biết mô hình nào phù hợp với máy mình?

LM Studio hiển thị ước tính RAM/VRAM cần thiết ngay trong giao diện khi bạn chọn mô hình. Mỗi mô hình đi kèm thẻ thông tin thể hiện kích thước, khả năng và các trường hợp sử dụng được khuyến nghị. Nguyên tắc đơn giản: RAM của bạn phải lớn hơn kích thước file mô hình.

Mac dùng chip Intel có dùng được LM Studio không?

Hiện tại, Mac dùng chip Intel không được LM Studio hỗ trợ. Chỉ có Apple Silicon (M1/M2/M3/M4) mới tương thích.

Máy tính không có GPU có dùng được không?

Được, nhưng sẽ chậm hơn đáng kể. Chế độ chỉ dùng CPU vẫn hoạt động được nhưng khoảng 3–8 token mỗi giây trên CPU hiện đại so với 20–60+ token mỗi giây khi dùng GPU phù hợp. Với mô hình nhỏ (3B–7B), tốc độ CPU vẫn đủ dùng cho tác vụ thông thường.

LM Studio có an toàn cho dữ liệu riêng tư không?

Chạy AI local giúp giảm rủi ro gửi dữ liệu lên dịch vụ bên ngoài. Tuy nhiên, khi dùng MCP Server, API, plugin hoặc kết nối mạng, bạn vẫn cần kiểm tra kỹ nguồn cài đặt và quyền truy cập.

LM Studio có thay thế ChatGPT được không?

LM Studio có thể thay thế một phần trong các tác vụ như chat, viết nội dung, tóm tắt tài liệu hoặc thử nghiệm local model. Tuy nhiên, chất lượng phản hồi phụ thuộc vào model được tải, cấu hình máy và cách viết prompt.

LM Studio có hỗ trợ tiếng Việt không?

Bản thân LM Studio là phần mềm giao diện tiếng Anh, nhưng các mô hình chạy bên trong hoàn toàn có thể giao tiếp tiếng Việt nếu bạn chọn đúng mô hình. Chỉ cần đặt câu hỏi bằng tiếng Việt và mô hình sẽ phản hồi tương ứng.

![Cách dùng API miễn phí với NVIDIA AI [2026]](https://tino.vn/blog/wp-content/uploads/2026/05/dung-api-mien-phi-voi-nvidia-ai-cover-150x150.png)

![Cách dùng API miễn phí với NVIDIA AI [2026]](https://tino.vn/blog/wp-content/uploads/2026/05/dung-api-mien-phi-voi-nvidia-ai-cover-260x176.png)